Am Freitag hat die US-Regierung Anthropic auf eine Stufe mit Huawei gestellt. Nicht wegen Spionage, nicht wegen Verbindungen zu feindlichen Staaten, sondern weil das Unternehmen sich weigerte, zwei Sicherheitsleitplanken aus einem Pentagon-Vertrag zu entfernen: keine Massenüberwachung von US-Bürgern, keine vollständig autonomen Waffensysteme.

Wenige Stunden später verkündete OpenAI, den frei gewordenen Platz übernommen zu haben. CEO Sam Altman behauptete, sein Deal enthalte dieselben Sicherheitsprinzipien. Aber wer genau hinschaut, sieht: OpenAI hat den entscheidenden Kompromiss gemacht, den Anthropic verweigerte.

Das klingt nach einer Geschichte aus Washington, die uns in Europa nicht betrifft. Das Gegenteil ist der Fall. Wer heute mit KI-Tools arbeitet, ob als Marketing-Team, als Agentur oder als Einzelperson, hat gerade einen Crashkurs in Anbieterabhängigkeit bekommen.

Die Kurzversion: Anthropic hatte im Juli 2025 einen Vertrag über bis zu 200 Millionen Dollar mit dem Pentagon abgeschlossen. Claude war das erste KI-Modell, das in den klassifizierten Netzwerken des US-Militärs eingesetzt wurde – für Aufklärungsanalysen, Planungsunterstützung, sogar bei der Festnahme des venezolanischen Präsidenten Maduro. Anthropic hatte dabei zwei rote Linien gezogen: Kein Einsatz für Massenüberwachung amerikanischer Bürger. Kein Einsatz in vollständig autonomen Waffen ohne menschliche Kontrolle.

Das Pentagon wollte diese Einschränkungen streichen. Nicht, weil es konkret vorhatte, Claude für Überwachung oder autonome Waffen einzusetzen – das betont die Behörde ausdrücklich. Sondern weil sie das Prinzip ablehnten, dass ein privates Unternehmen dem Militär vorschreiben kann, wofür eine lizenzierte Technologie verwendet werden darf.

Verteidigungsminister Hegseth setzte Anthropic eine Frist bis Freitag, 17:01 Uhr. Anthropic lehnte ab. CEO Dario Amodei schrieb, sein Unternehmen könne „in gutem Gewissen“ nicht einlenken. Trump reagierte auf Truth Social – und erklärte die Firma zur Bedrohung der nationalen Sicherheit.

Die Bezeichnung „Supply-Chain Risk“ ist normalerweise Unternehmen aus feindlichen Staaten vorbehalten. Sie bedeutet: Jeder Militärdienstleister muss nachweisen, dass er nicht mit Anthropic zusammenarbeitet. Die Konsequenz reicht weit über den Pentagon-Vertrag hinaus.

Hier wird die Geschichte richtig interessant: Noch am selben Abend gab OpenAI-CEO Sam Altman bekannt, einen Deal mit dem Pentagon unterzeichnet zu haben. In seinem X-Post schrieb er, das Abkommen enthalte Verbote von Massenüberwachung und Verpflichtungen zu menschlicher Verantwortung bei Waffensystemen. Das klingt auf den ersten Blick nach denselben roten Linien, die Anthropic gefordert hatte. Aber der entscheidende Unterschied liegt im Kleingedruckten.

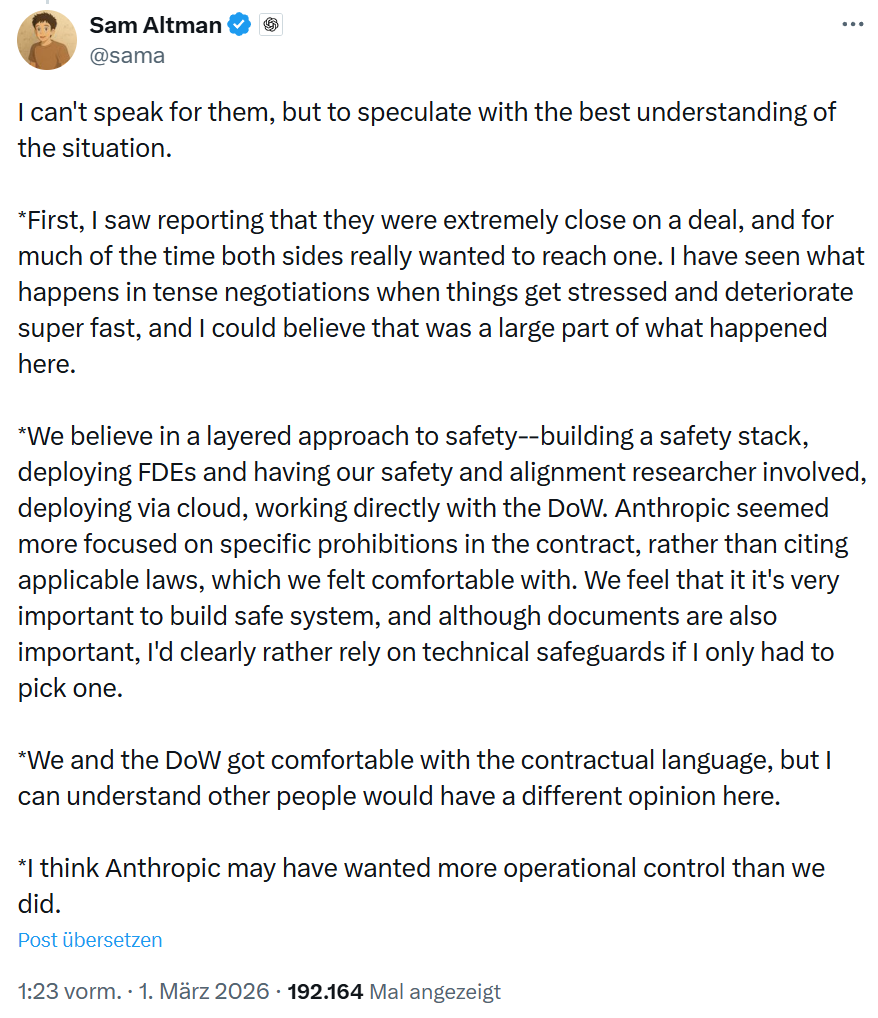

OpenAI hat der Pentagon-Forderung zugestimmt, seine Modelle für „all lawful purposes“ – für alle gesetzlich zulässigen Zwecke – einsetzen zu lassen. Genau die Formulierung, die Anthropic als zu schwach abgelehnt hatte. Altman selbst sagte in einem AMA auf X: „Anthropic seemed more focused on specific prohibitions in the contract, rather than citing applicable laws, which we felt comfortable with.“

Warum das kein Wortklauberei ist: Anthropic-CEO Amodei hat in einem CBS-Interview ein konkretes Beispiel genannt. Die US-Regierung könnte kommerzielle Datensätze kaufen – Standortdaten, Browsing-Verhalten, Finanzinformationen – und diese mit KI analysieren. Das wäre nach geltendem Recht möglicherweise legal und würde nicht als „Massenüberwachung“ gelten. Genau dieses Schlupfloch wollte Anthropic vertraglich schließen.

OpenAIs Vertragssprache bezieht sich laut Axios nur auf die „unconstrained“ Sammlung privater Daten – nicht öffentlich verfügbarer Daten. Und auch bei autonomen Waffen gibt es einen semantischen Unterschied: Anthropic forderte „human oversight“ – menschliche Echtzeitkontrolle. OpenAI formulierte „human responsibility for the use of force“, was auch eine nachträgliche Verantwortlichkeit einschließen könnte, ohne dass ein Mensch in Echtzeit entscheidet.

In einer internen Mail an seine Mitarbeitenden, die verschiedene Medien einsehen konnten, hatte Altman noch am Donnerstag geschrieben, OpenAI teile die gleichen roten Linien wie Anthropic. Am Freitag gegenüber CNBC sagte er, das Pentagon solle keine Unternehmen mit dem Defense Production Act bedrohen. Wenige Stunden später hatte er den Vertrag – auf Basis genau der Bedingungen, die Anthropic als unzureichend bezeichnete. Altman selbst räumte auf X ein: „Yes, I am“ besorgt darüber, ob es später zu einem Streit mit dem Pentagon über die Auslegung kommen könnte. „If we have to take on that fight we will, but it clearly exposes us to some risk.“

Es wäre einfach, diese Geschichte als politisches Theater zu lesen. Trump braucht einen Feind, Anthropic taugt als „woke“ Feindbild, OpenAI übernimmt. Und ja, die Dynamik hat eine offensichtlich politische Dimension. Elon Musks xAI konkurriert direkt mit Anthropic, und Musk hat in den vergangenen Wochen wiederholt auf X geschrieben, Anthropic „hasse die westliche Zivilisation“.

Aber unter der Oberfläche steckt eine Frage, die jedes Unternehmen betrifft, das KI-Technologie einsetzt: Was passiert, wenn die Regierung eines Landes entscheidet, dass dein Technologieanbieter ein Sicherheitsrisiko ist?

Seit Januar 2026 ist Claude als Subprozessor in Microsoft 365 Copilot standardmäßig aktiviert – für den Researcher-Agenten, Copilot Studio und mehr. Wenn die Supply-Chain-Risk-Bezeichnung breit durchgesetzt wird, müssten US-Militärdienstleister nachweisen, dass sie Claude in keinem Workflow nutzen. Microsoft-Partner, die auch Pentagon-Aufträge bedienen, stehen vor der Frage: Claude deaktivieren – überall, vorsichtshalber – oder riskieren, dass ein Audit Probleme aufdeckt?

Für europäische Unternehmen ohne US-Militärgeschäft ändert sich rechtlich erstmal nichts. Anthropic selbst betont, dass die Supply-Chain-Designation nur Pentagon-Verträge betrifft. Aber das Signal ist eindeutig: Selbst ein 380-Milliarden-Dollar-Unternehmen kann von einer Regierung innerhalb eines Tages zum Sicherheitsrisiko erklärt werden. Nicht wegen technischer Mängel, nicht wegen Datenschutzverletzungen, sondern wegen einer ethischen Position.

Die Reaktion der Branche war bemerkenswert. Über 450 Mitarbeitende von Google und OpenAI unterzeichneten innerhalb weniger Tage einen offenen Brief mit dem Titel „We Will Not Be Divided“. Darin fordern sie ihre Unternehmensleitungen auf, sich solidarisch zu zeigen und dieselben roten Linien zu verteidigen. Über 100 Google-Mitarbeitende schrieben zusätzlich einen internen Brief an DeepMind-Chef Jeff Dean mit der Forderung nach klaren Grenzen in Regierungsverträgen.

Das ist ungewöhnlich. In einer Branche, in der Unternehmen normalerweise jeden Wettbewerbsvorteil gegeneinander nutzen, stellen sich Mitarbeitende öffentlich hinter den Konkurrenten. Dean Ball, zuvor Trumps eigener KI-Berater im Weißen Haus, nannte die Maßnahme gegen Anthropic „versuchten Unternehmensmord“ und warnte, er könne keinem Investor mehr empfehlen, in amerikanische KI zu investieren.

Senator Thom Tillis, Republikaner, fragte öffentlich, warum diese Verhandlungen überhaupt in der Öffentlichkeit geführt würden. Senator Mark Warner, der ranghöchste Demokrat im Geheimdienstausschuss, sprach von einer „gefährlichen Instrumentalisierung der Beschaffungspolitik, um ein Unternehmen für ethische Standards zu bestrafen.“

Gleichzeitig – und das ist der Punkt, der mich am meisten beschäftigt – bekam OpenAI den Deal. Nicht mit denselben Bedingungen, wie Altman suggeriert, sondern mit weicherer Vertragssprache, die auf geltendes Recht verweist statt auf explizite Verbote. Was den Schluss nahelegt: Es ging nie nur um die inhaltlichen Forderungen. Es ging um die Frage, ob ein privates Unternehmen dem Militär harte vertragliche Grenzen setzen darf – oder ob ein Verweis auf bestehende Gesetze ausreicht, deren Auslegung die Regierung selbst kontrolliert.

Für die Menschen, die in unseren Seminaren sitzen, hat dieser Konflikt drei unmittelbare Konsequenzen.

Die erste betrifft Vendor-Abhängigkeit. Wer heute seine Workflows um ein einziges KI-Modell baut, baut auf einem Fundament, das politische Erdbeben nicht aushält. Das gilt nicht nur für Anthropic. Google, OpenAI, xAI – jeder dieser Anbieter operiert in einem politischen Umfeld, das sich innerhalb von Stunden ändern kann. Wer sich erinnert: Erst vor drei Wochen hat die EU ein Verfahren gegen X eingeleitet. Die Vorstellung, dass KI-Anbieter stabile, neutrale Infrastruktur-Partner sind, ist eine Illusion.

Die zweite Konsequenz betrifft Datenschutz. Ein Unternehmen, das als „Supply-Chain Risk“ eingestuft wird, unterliegt einer verschärften Prüfung. Europäische Unternehmen, die unter der DSGVO personenbezogene Daten an US-Anbieter übermitteln, müssen jetzt genauer hinschauen, mit welchem Anbieter sie welche Daten teilen. Nicht, weil Anthropic unsicherer geworden wäre – sondern weil die politische Instabilität des regulatorischen Umfelds gestiegen ist.

Die dritte Konsequenz betrifft die Frage, wem wir vertrauen. Anthropic hat gerade unter erheblichem finanziellem Druck eine ethische Position verteidigt – und dafür bezahlt. OpenAI hat dieselbe Position rhetorisch geteilt, aber im entscheidenden Moment einen Deal unterschrieben, der auf genau der Vertragssprache basiert, die Anthropic als zu schwach ablehnte. Altman gibt selbst zu, dass er „besorgt“ ist, ob die Formulierungen im Ernstfall halten. Man kann das als Pragmatismus lesen – oder als Zeichen dafür, dass „rote Linien“ bei manchen Unternehmen eher Verhandlungsmasse als Überzeugung sind.

Was mich an der gesamten Debatte am meisten stört: Sie zeigt, wie vollständig die europäische KI-Infrastruktur von amerikanischen Anbietern abhängt. Es gibt kein europäisches Frontier-Modell. Es gibt keinen europäischen Anbieter, der auf Augenhöhe mit Claude, GPT oder Gemini konkurriert. Mistral kommt am nächsten, operiert aber in einer anderen Gewichtsklasse.

Das bedeutet: Wenn die US-Regierung entscheidet, dass ein KI-Anbieter ein Sicherheitsrisiko ist, hat Europa keine Alternative. Nicht weil es an Talent mangelt, sondern weil das Kapital, die Recheninfrastruktur und die Skalierung nicht vorhanden sind.

Für Marketing-Teams ist das keine abstrakte geopolitische Sorge. Es ist die Frage, ob du in zwölf Monaten noch denselben KI-Assistenten nutzen kannst wie heute. Und ob die Bedingungen, unter denen du ihn nutzt, von einem Unternehmen definiert werden, das deine Interessen vertritt – oder von einer Regierung, die gerade einen geopolitischen Punkt machen will.

1. Mach eine Bestandsaufnahme deiner KI-Abhängigkeiten. Welche Tools nutzt dein Team? Welche Modelle laufen im Hintergrund? Viele Teams wissen nicht, dass ihr Copilot Claude nutzt oder dass ihr Content-Tool auf GPT basiert. Liste auf, wo KI steckt – sichtbar und unsichtbar.

2. Teste die Portabilität deiner Workflows. Nimm drei typische Aufgaben, die du mit deinem Haupt-KI-Tool erledigst, und probiere sie mit einer Alternative. Nicht weil du wechseln musst, sondern weil du wissen musst, wie schnell du wechseln könntest. Ein Prompt, der nur in Claude funktioniert, ist kein Workflow.

3. Dokumentiere deine Prompts und Prozesse modellunabhängig. Statt „mein Claude-Prompt für Briefings“ zu speichern, dokumentiere: Was ist die Aufgabe? Was ist der Input? Was soll der Output sein? Welcher Kontext ist nötig? Gute Prompts beschreiben die Aufgabe, nicht das Tool.

4. Überprüfe, welche Daten du in welche Systeme gibst. Kundendaten, Strategiedokumente, interne Kommunikation: Was davon geht in KI-Tools? Und welchem Rechtsrahmen unterliegt der Anbieter? Das war schon vor dem Anthropic-Bann wichtig. Jetzt ist es dringend.

5. Sprich im Team darüber. Nicht über Trump oder Pentagon-Politik, sondern über die konkrete Frage: Wie abhängig sind wir? Und was ist unser Plan B? Das ist keine Panikmache. Das ist professionelles Risikomanagement.

Disclosure: Das KI Marketing Bootcamp hat keine Geschäftsbeziehung mit Anthropic, OpenAI oder dem Pentagon!

Hinweis: Der Text wurde mit Hilfe von generativer KI erstellt, Anbieter: Anthropic.

NPR (2026). „OpenAI announces Pentagon deal after Trump bans Anthropic.“ 27. Februar 2026.

CNBC (2026). „Anthropic faces lose-lose scenario in Pentagon conflict.“ 27. Februar 2026.

CNBC (2026). „OpenAI strikes deal with Pentagon, hours after rival Anthropic was blacklisted by Trump.“ 27. Februar 2026.

CNN (2026). „Anthropic rejects latest Pentagon offer.“ 26. Februar 2026.

CNN (2026). „OpenAI strikes deal with Pentagon hours after Trump admin bans Anthropic.“ 27. Februar 2026.

Axios (2026). „OpenAI-Pentagon deal faces same safety concerns that plagued Anthropic talks.“ 1. März 2026.

Axios (2026). „Trump moves to blacklist Anthropic’s Claude from government work.“ 27. Februar 2026.

ABC News (2026). „Trump orders US government to cut ties with Anthropic.“ 27. Februar 2026.

Engadget (2026). „Google and OpenAI employees sign open letter in solidarity with Anthropic.“ 27. Februar 2026.

buckleyPLANET (2026). „The Anthropic Ban and What It Means for Microsoft Partners and Customers.“ 2. März 2026.

The Decoder (2026). „The Pentagon-OpenAI-Anthropic fallout comes down to three words: ‚all lawful use‘.“ 1. März 2026.

Fox Business (2026). „OpenAI CEO Sam Altman answers questions on new Pentagon deal.“ 1. März 2026.

TechPolicy.Press (2026). „A Timeline of the Anthropic-Pentagon Dispute.“ 2. März 2026.

Sie sehen gerade einen Platzhalterinhalt von Vimeo. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenSie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenSie müssen den Inhalt von reCAPTCHA laden, um das Formular abzuschicken. Bitte beachten Sie, dass dabei Daten mit Drittanbietern ausgetauscht werden.

Mehr InformationenSie sehen gerade einen Platzhalterinhalt von Facebook. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenSie sehen gerade einen Platzhalterinhalt von Instagram. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenSie sehen gerade einen Platzhalterinhalt von X. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr Informationen