Manchmal entwickeln sich aus einem Workshop ganz besondere Projekte. So geschehen nach einer KI-Schulung in der VDMB Akademie, als die Anfrage kam, für das VDMB Jahresmagazin 2024 die Autorenportraits mittels künstlicher Intelligenz zu erstellen. Eine spannende Aufgabe, die nicht nur die Portraits der Autoren betraf, sondern auch in einem vierseitigen Interview über die Möglichkeiten von KI im Printbereich mündete.

In diesem Artikel zeige ich dir, wie wir die KI-generierten Portraits für das Magazin entwickelt haben. Du erfährst, welche technischen Schritte nötig waren, wie der Workflow aussah und welche Besonderheiten es bei der Umsetzung gab.

Der Auftrag: Innovation im Printbereich

Die Produktion eines hochwertigen Magazins stellt besondere Anforderungen an die visuelle Qualität. Für das VDMB Jahresmagazin 2024 wurde dabei ein innovativer Weg eingeschlagen: Statt klassischer Fotoshootings sollten die Autorenportraits mittels künstlicher Intelligenz entstehen.

Nach einem intensiven KI-Workshop in der VDMB Akademie entwickelte sich die Idee, diese Technologie direkt in der Praxis einzusetzen. Der Verband Druck und Medien Bayern wollte damit nicht nur über digitale Innovation berichten, sondern sie aktiv demonstrieren – ein Ansatz, der perfekt zur zukunftsorientierten Ausrichtung des Magazins passt.

Die Herangehensweise war dabei bewusst niederschwellig: Als Ausgangsmaterial dienten Smartphone-Aufnahmen der Autoren. Diese Fotos bildeten die Grundlage für das Training personalisierter KI-Modelle. Unser Ziel war es, hochwertige Portraits zu generieren, die sowohl den technischen Anforderungen des Printbereichs entsprechen als auch die individuellen Charakteristika der porträtierten Personen authentisch wiedergeben.

Technische Umsetzung: Von Fotos zu KI-Portraits

Der technische Kern des Projekts basierte auf Flux.1 [dev], einem spezialisierten KI-Modell für fotorealistische Portraitgenerierung. Dieses Basismodell wurde durch individuelle LoRAs (Low-Rank Adaptations) für jeden Autor personalisiert – eine Technik, die es ermöglicht, bestehende KI-Modelle gezielt auf spezifische Gesichtszüge zu trainieren.

Das Training

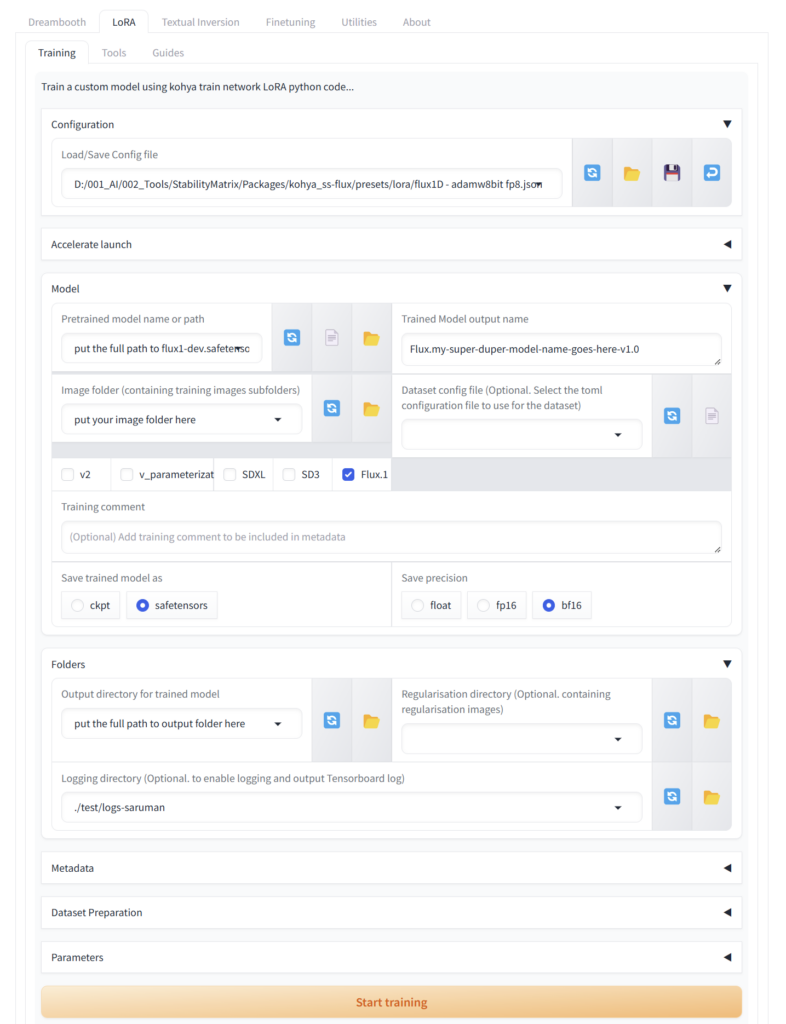

Für das Training nutzten wir kohya_ss, ein bewährtes Tool für die Entwicklung von LoRAs. Die Trainingsparameter wurden dabei bewusst konservativ gewählt:

- 4000 Trainingsschritte (Steps)

- Rank 64

- Learningrate von 0.000075

Diese Kombination aus hoher Schrittanzahl, hohem Rank und niedriger Learningrate hat sich als optimal für qualitativ hochwertige Ergebnisse erwiesen. Sie sorgt für eine ausgezeichnete Wiedererkennbarkeit der Personen und bietet gleichzeitig die nötige Flexibilität bei der späteren Bildgenerierung.

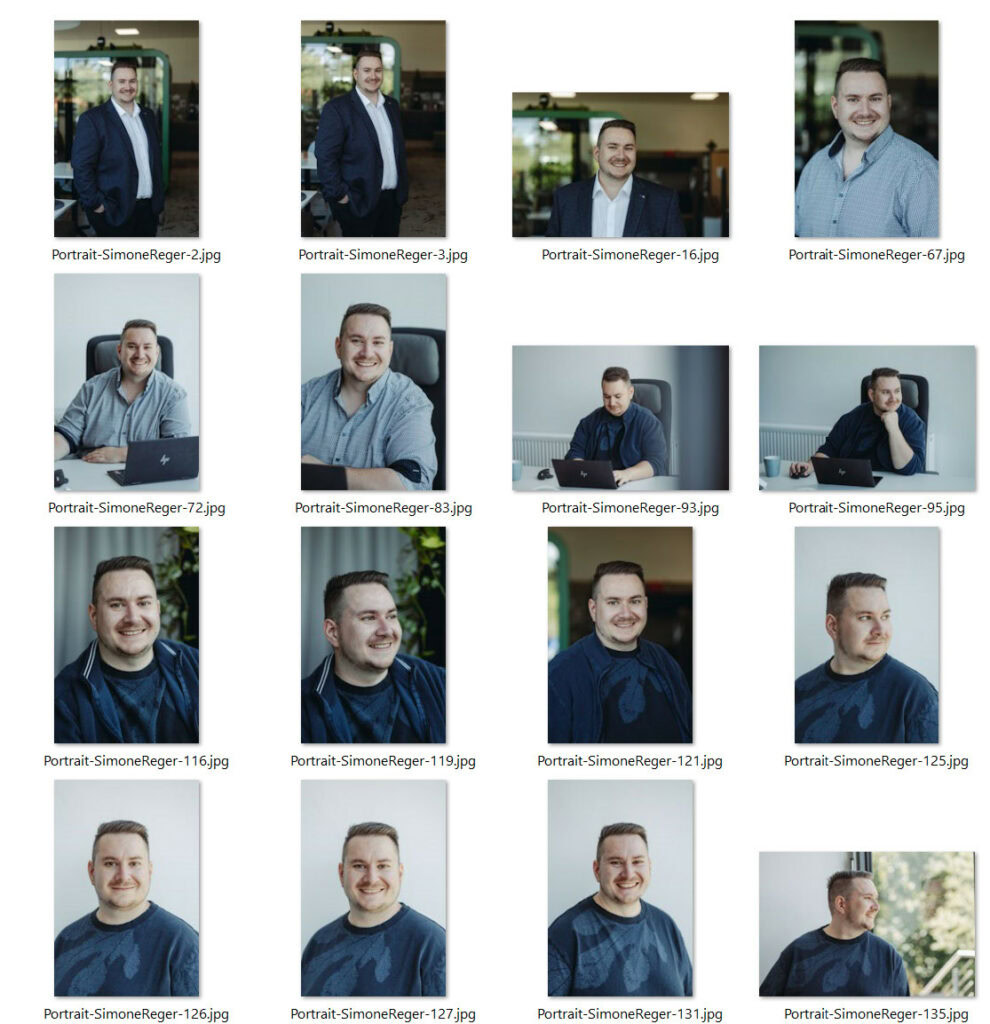

Die Trainingsdaten

Als Grundlage dienten pro Person 10-20 Smartphone-Aufnahmen. Diese wurden nach groben Vorgaben erstellt, um optimale Trainingsergebnisse zu gewährleisten. Wichtig waren dabei verschiedene Perspektiven, Ausschnitte, Hintergründe und Kleidung, die später eine vielseitige Generierung ermöglichten.

Der Generierungsprozess: Qualität durch Komplexität

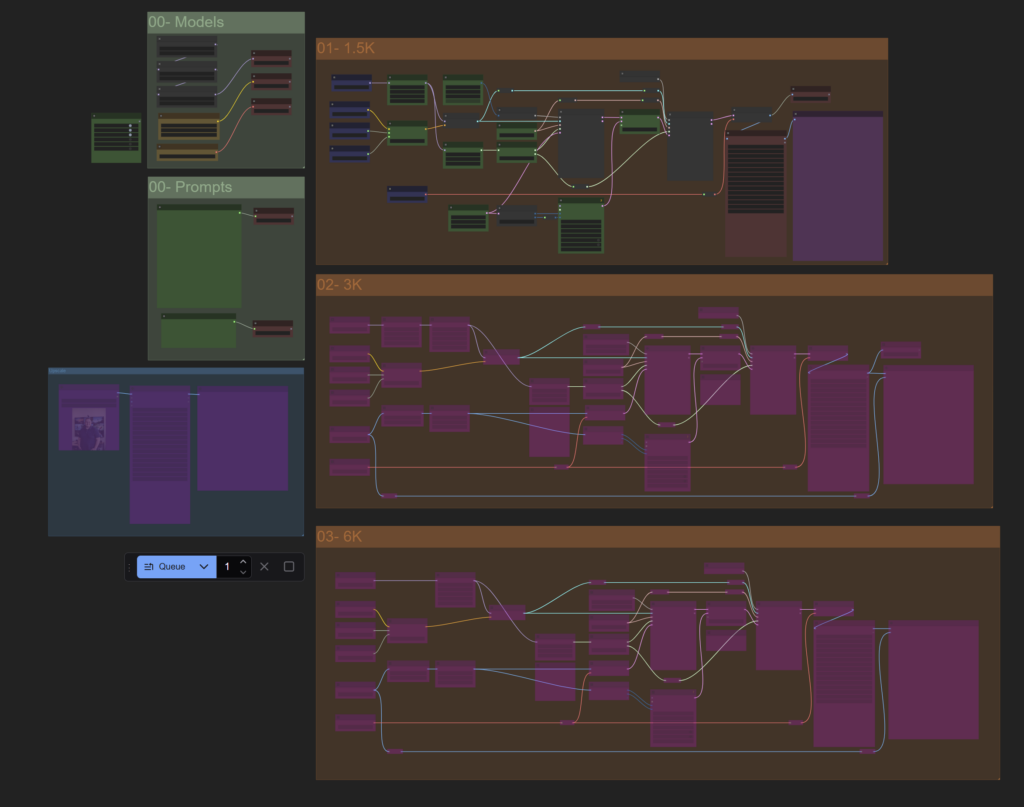

Die eigentliche Bildgenerierung erfolgte über einen spezialisierten ComfyUI-Workflow. ComfyUI, als node-basierte Oberfläche für Bildgenerierung, ermöglichte uns dabei eine präzise Kontrolle über jeden einzelnen Parameter des Generierungsprozesses.

Technische Verfeinerung

Eine Besonderheit des Workflows war die Integration von Noise Injection – eine Technik, die durch gezieltes Hinzufügen von „Rauschen“ während der Generierung für mehr Variation und Natürlichkeit in den Ergebnissen sorgt. In Kombination mit einem zusätzlichen Realism LoRA erreichten wir eine neue Qualitätsstufe bei den generierten Portraits. Der Workflow basiert in seinen Grundzügen auf einem Workflow des kanadischen Fotografen Albert Zablit.

Für jede Person wurden etwa 360 Bilder generiert, wobei jedes Bild etwa 60 Sekunden Rechenzeit benötigte. Diese große Menge an Generierungen war notwendig, um eine optimale Auswahl für das hochwertige Printprodukt zu gewährleisten.

Nachbearbeitung und Selektion

Nach der Generierung folgte ein mehrstufiger Auswahlprozess:

- Erste Sichtung und Vorauswahl der technisch besten Bilder

- Detaillierte Qualitätsprüfung auf Konsistenz und Wiedererkennbarkeit

- Finale Auswahl von 4-5 Bildern pro Person

- Professionelle Nachbearbeitung und Upscaling für den Printbereich

Zeit- und Ressourcenaufwand: Der Weg zum perfekten Portrait

Die Erstellung hochwertiger KI-Portraits für ein Printmagazin ist ein komplexer Prozess, der sich über mehrere Phasen erstreckt. Pro Autor investierten wir etwa 5-6 Stunden Gesamtarbeitszeit, die sich wie folgt aufgliederte:

Training und Generierung

- Vorbereitung und Training des personalisierten LoRA: ~1 Stunde

- Generierung von 360 Bildern: ~6 Stunden Rechenzeit

- Parallele Überwachung und Feinjustierung der Parameter

Nachbearbeitung und Finalisierung

Etwa 4 Stunden pro Autor flossen in:

- Sorgfältige Sichtung und Vorauswahl der Bilder

- Detaillierte Retusche und Nachbearbeitung

- Upscaling für Druckqualität

- Abstimmungsrunden mit dem VDMB-Team

Ein besonderer Vorteil dieses Workflows: Der gesamte Prozess konnte remote durchgeführt werden. Während bei klassischen Fotoshootings die Koordination von Terminen und Locations oft eine große Herausforderung darstellt, ermöglichte die KI-gestützte Produktion eine flexible und ortsunabhängige Arbeitsweise.

Fazit: KI im hochwertigen Print – ein Blick in die Zukunft

Die Produktion der Portraits für das VDMB Jahresmagazin 2024 zeigt eindrucksvoll, wie KI-generierte Bilder heute schon professionell im Printbereich eingesetzt werden können. Der Workflow von der ersten Smartphone-Aufnahme bis zum druckfertigen Portrait ist zwar technisch anspruchsvoll, bietet aber entscheidende Vorteile gegenüber traditionellen Produktionswegen.

Effizienz neu gedacht

Der größte Gewinn liegt in der Flexibilität: Keine Terminkoordination für Fotoshootings, keine Anreisen, keine Studiomiete. Stattdessen ein durchdachter, digitaler Workflow, der hochwertige Ergebnisse liefert. Die Investition von etwa 5-6 Stunden pro Portrait mag auf den ersten Blick hoch erscheinen, relativiert sich aber im Vergleich zum Organisationsaufwand klassischer Fotoproduktionen.

Qualität und Authentizität

Die finale Qualität der Portraits zeigt, dass KI-generierte Bilder heute den hohen Ansprüchen des Printbereichs gerecht werden können. Dabei geht es nicht darum, klassische Fotografie zu ersetzen, sondern neue Möglichkeiten zu erschließen und bestehende Workflows zu ergänzen.

Das VDMB Jahresmagazin 2024 ist damit mehr als nur eine Publikation – es ist ein Beispiel dafür, wie Innovation im Printbereich praktisch umgesetzt werden kann. Es zeigt, dass die Druckbranche nicht nur über digitale Transformation spricht, sondern sie aktiv gestaltet.

Dein eigener KI-Zwilling: Der nächste Schritt

Die Erstellung der Portraits für das VDMB Jahresmagazin zeigt eindrucksvoll, welches Potenzial in der KI-gestützten Bildgenerierung steckt. Möchtest du selbst lernen, wie du solche hochwertigen KI-Portraits erstellst? In unserem Live Deep Dive „Klon dich selbst mit Flux & CustomGPTs“ zeigen wir dir, wie du deinen eigenen digitalen Zwilling erschaffst.

Du lernst nicht nur die technischen Details wie das Training von LoRAs und die Feinheiten des Promptings, sondern auch, wie du die generierten Bilder strategisch für dein Personal Branding einsetzt. In sechs intensiven Stunden bekommst du das komplette Know-how, um selbst hochwertige KI-Portraits zu erstellen – von der Aufnahme der Trainingsfotos bis zur finalen Bildgenerierung.

Profitiere von unseren Erfahrungen aus über 50 LoRA-Trainings und spare dir mühsames Trial and Error. Der nächste Deep Dive findet bereits bald statt, die Teilnehmerzahl ist auf 8 Personen begrenzt.