Cloud-basierte KI-Tools haben ihre Grenzen – das merken Unternehmen spätestens dann, wenn sie täglich hunderte Bilder generieren müssen oder sensible Produktdaten nicht an Dritte weitergeben wollen. Lokale KI-Setups bieten hier die Lösung: volle Kontrolle, keine API-Limits und die Möglichkeit, eigene Modelle zu trainieren. Doch der Weg zur eigenen KI-Workstation ist nicht ohne Tücken. Hier erfährst du, worauf es ankommt.

Inhaltsverzeichnis

Warum lokal statt Cloud?

Die meisten starten mit Bild-KI in der Cloud – logisch, denn die Einstiegshürde ist niedrig. Aber wer tiefer einsteigt, merkt schnell: Lokale Workflows bieten enorme Vorteile bei Flexibilität, Performance und Datenschutz. Du behältst die volle Kontrolle ohne API-Limits oder Cloud-Abhängigkeit, deine Daten bleiben DSGVO-konform auf deinen Servern, und bei komplexen Trainingsworkflows merkst du sofort den Performance-Unterschied. Die Hardware-Investition rechnet sich schnell bei regelmäßiger Nutzung, und du kannst individuelle Workflows mit Custom Models, LoRA Training oder eigenem Fine-Tuning entwickeln.

Der Umstieg lohnt sich ab einer bestimmten Nutzungsfrequenz: Wer täglich 50+ Bilder generiert, stößt schnell an API-Limits und spürt die steigenden Kosten. Bei sensiblen Daten wie Produktprototypen oder internen Designs ist lokale Verarbeitung oft sogar rechtlich notwendig. Auch für konsistente Stile, Corporate Identity oder spezielle Looks führt kein Weg an eigenen Modellen vorbei. Für gelegentliche Experimente reichen Cloud-Tools völlig aus, aber wer täglich generiert, sensible Daten hat oder eine eigene visuelle Sprache entwickeln will, profitiert massiv von lokalen Workflows.

Lust auf lokale Power?

Du hast genug von API-Limits und willst deine eigenen KI-Modelle trainieren? Dann lass uns das Setup gemeinsam angehen. Wir zeigen dir, welche Hardware sich lohnt, welche Software funktioniert und wie du ohne Frickelei zum Ziel kommst.

Die Schattenseite – was es komplex macht

Aber seien wir ehrlich: Der Weg dahin ist nicht smooth. Das technische Setup kann nerven – Treiber, CUDA, Modelle und Abhängigkeiten sind nicht für Ungeduldige gemacht. Du brauchst Know-how, um deine Hardware zu verstehen und die Software zum Laufen zu bringen. Mal eben schnell installieren und loslegen? Fehlanzeige.

Besonders spannend wird’s bei AMD-Karten. Wer auf günstige AMD-GPUs setzt, braucht bei Bildgenerierung starke Nerven. Die meisten Open-Source-Tools für Bild-KI laufen nur mit viel Tool-Frickelei oder gar nicht sauber. Das liegt an der fehlenden CUDA-Unterstützung – ein echter Stolperstein, der AMD leider speziell bei Bildgenerierung zur No-Go-Option macht.

Welche Hardware macht wirklich Sinn?

Die Anforderungen sind klar: Eine GPU mit mindestens 12 GB VRAM ermöglicht den Einstieg in die lokale KI-Generierung. Ab 24 GB VRAM wird’s komfortabel für komplexere Workflows und LoRA-Training. Für professionelle Anwendungen geht’s aber noch deutlich weiter.

| Kategorie | Empfehlung/Modell | VRAM | Preis (ca.) | Geeignet für | Besonderheiten |

|---|---|---|---|---|---|

| Einstieg | RTX 3090 (gebraucht) | 24 GB | 1.000 € | Einfache Generierung, gutes P/L-Verhältnis | Gebrauchtkauf empfohlen |

| High-End | RTX 5090 | 32 GB | 2.500 € | High-End Performance, große Modelle | Neueste Generation, sehr leistungsstark |

| Profi | RTX 6000 Ada / 6000 Pro Blackwell | 48 GB | >8.000 € | Serien-LoRA-Training, große Modelle (z.B. HiDream) | Profi-Niveau, sehr teuer |

Werbung:

Mit dieser Hardware arbeitet Georg Neumann:

Seit September 2024 arbeitet unser Bild-KI Spezialist und KI Marketing Bootcamp Mitgründer Georg Neumann mit einer Lenovo Thinkstation P8 und kommt aus dem Schwärmen garnicht mehr raus:

Seit der ThinkStation schaffe ich locker das Doppelte am Tag. Nicht weil ich schneller arbeite, sondern weil die Hardware endlich mitspielt. Mehr Output, weniger Frust – so sollte es sein.

Georg Neumann

Workloads, die jetzt schneller und zuverlässiger laufen oder überhaupt erst durch die Thinkstation möglich sind:

- Flux.1 [dev] LoRA Training für mein SaaS flaic.de und Full Finetunings

- Bildgenerierung mit ComfyUI auch mit großen Modellen wie HiDream

- Nutzung von Sprachmodellen über ollama

- Kreatives Arbeiten in der Adobe Suite inkl. blitzschnellen Videorenderings

Lenovo Thinkstation P8

| Komponente | Spezifikation |

|---|---|

| Prozessor | AMD Ryzen Threadripper Pro 7975WX mit 32 CPU-Kernen |

| Arbeitsspeicher | 128GB DDR5 RAM |

| Grafikkarte | Nvidia RTX 6000 Ada mit 48GB VRAM |

Vielen Dank an Lenovo Deutschland und wunderow IT GmbH für die Unterstützung!

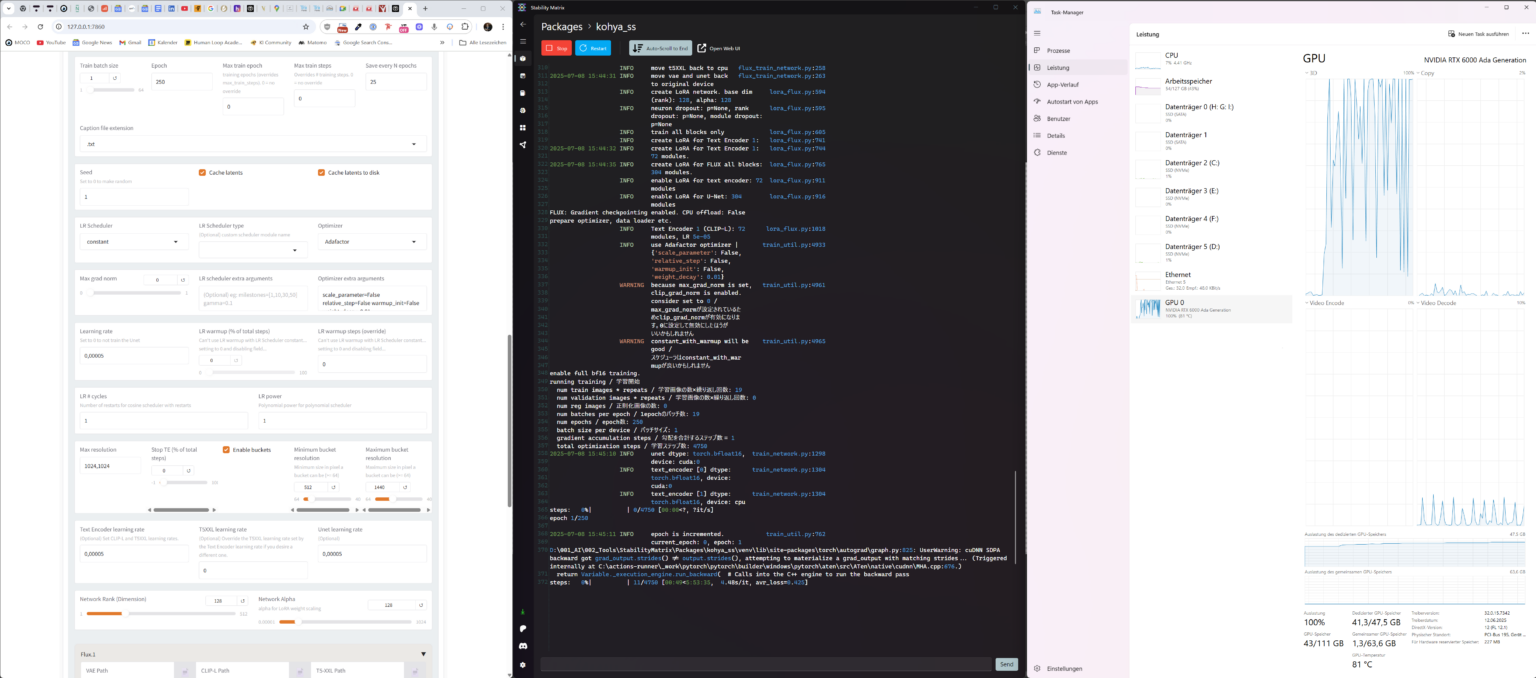

Und so sieht das in der Praxis aus:

Flux LoRA Training auf Georgs Workstation. Links die Parameter, Mitte das Live-Training, rechts 100% GPU-Auslastung – echte lokale Power!

Inspiration für dein erstes Projekt findest du in unserem Personalisiertes Kinderbuch mit KI Praxisguide.

Software & Tools – von einfach bis nerdig

Bei der Software hast du die Qual der Wahl. Einsteigerfreundlich ist die Reforge WebUI – ein einfaches Interface, das einen guten Startpunkt für erste Projekte bietet. Noch komfortabler wird’s mit Stability Matrix, einem Installer und Launcher für Windows, Mac und Linux, der vieles vereinfacht. Den findest du auf GitHub.

Fortgeschrittene und Profis schwören auf ComfyUI – das mächtigste Tool, wenn du alles individuell bauen willst. Für LoRA-Trainings sind kohya_ss und Ostris AI Toolkit der Standard. Spezielle Flux-Techniken wie In-Context Editing zeigen wir dir in unserem In-Context Editing mit FLUX.1 Blogbeitrag.

Fazit: Lokale Power für echte Ergebnisse

Wer ernsthaft mit generativer Bild-KI arbeiten will, kommt früher oder später an lokalen Setups nicht vorbei. Ja, der Einstieg ist anspruchsvoller als ein paar Klicks in der Cloud – aber die Möglichkeiten sind grenzenlos. Mit der richtigen GPU und einem soliden Setup kannst du dein eigener Model-Engineer werden, ohne Abhängigkeit von Cloud-Anbietern oder rechtlich fragwürdigen Plattformen.

Die Investition lohnt sich, besonders für Unternehmen, die regelmäßig hochwertige, konsistente Bilder benötigen. Du bekommst nicht nur bessere Kontrolle und Performance, sondern auch die Freiheit, deine eigenen Workflows zu entwickeln.

Bereit für den nächsten Schritt?

Die Tools entwickeln sich schnell, und jedes hat seine Besonderheiten.

Im KI Marketing Bootcamp gehen wir systematisch vor: Von der Strategie über die Tool-Auswahl bis zur konkreten Umsetzung. Du lernst nicht nur die Theorie, sondern arbeitest an echten Projekten – mit direktem Feedback und praktischen Workflows, die du sofort einsetzen kannst.

Was erwartet dich?

- Praxisorientierte Anleitungen: Lerne, wie du KI-Tools strategisch einsetzt und das Beste aus ihnen herausholst

- Erprobte Workflows: Vom Konzept bis zur Umsetzung – mit sofort anwendbaren Strategien

- Individuelle Begleitung: Kleine Gruppen und persönliche Betreuung bei deinen Projekten

Deine Vorteile:

- Learning by Doing: Entwickle eigene Kampagnen, die auf deine spezifischen Ziele zugeschnitten sind

- Praxiswissen: Nutze echte Beispiele und Erfolgsstrategien für deine eigenen Projekte

- 100% Online: Flexibel lernen, wann es in deinen Zeitplan passt

Für Unternehmen: Maßgeschneiderte Workshops für dein Marketing-Team.

Dein Expertenteam: Vroni Hackl und Georg Neumann – dein Expertenteam und deine Guides durch KI im Marketing.