Dein Avatar soll in jeder Szene gleich aussehen? Dann kennst du vermutlich das Problem: KI-Tools ‚vergessen‘ gerne, wie dein Charakter aussieht. Mal sind die Augen anders, mal die Frisur, mal die kompletten Gesichtszüge.

Die gute Nachricht: Es gibt bewährte Methoden für echte Charakterkonsistenz. Wir haben uns vier verschiedene Ansätze genauer angeschaut, getestet und zeigen dir anhand praktischer Beispiele, welche Methode wann funktioniert – und wo die Grenzen liegen.

Inhaltsverzeichnis

Die vier Wege zur Charakterkonsistenz

Dialogbasierte Ansätze (ChatGPT & Co.)

Wie es funktioniert: Du startest mit einem detaillierten Prompt: „Erstelle einen freundlichen Marketing-Manager, 30 Jahre, blonde Haare, blaues Hemd…“ Die KI generiert deinen Charakter. Bei jedem Folgebild referenzierst du explizit: „Nutze denselben Charakter aus dem vorherigen Bild und zeige ihn vor einem Laptop.“

Der Trick: Je präziser deine Anfangsbeschreibung, desto besser das „Kurzzeitgedächtnis“ der KI.

Praxis-Tipp: Nach 3-4 Bildern solltest du den ursprünglichen Charakter wieder explizit erwähnen, um die schleichende „Charakterdrift“ zu verhindern. Die besten Ergebnisse bekommt man, wenn man es in jedem Prompt erwähnt und das Bild als Referenz hinterlegt.

Perfekt für: Schnelle Konzepte, fiktive Charaktere, Storytelling, Maskottchen-Entwicklung

Grenzen: Bei realen Personen noch unzuverlässig, Konsistenz lässt über längere Bildstrecken nach

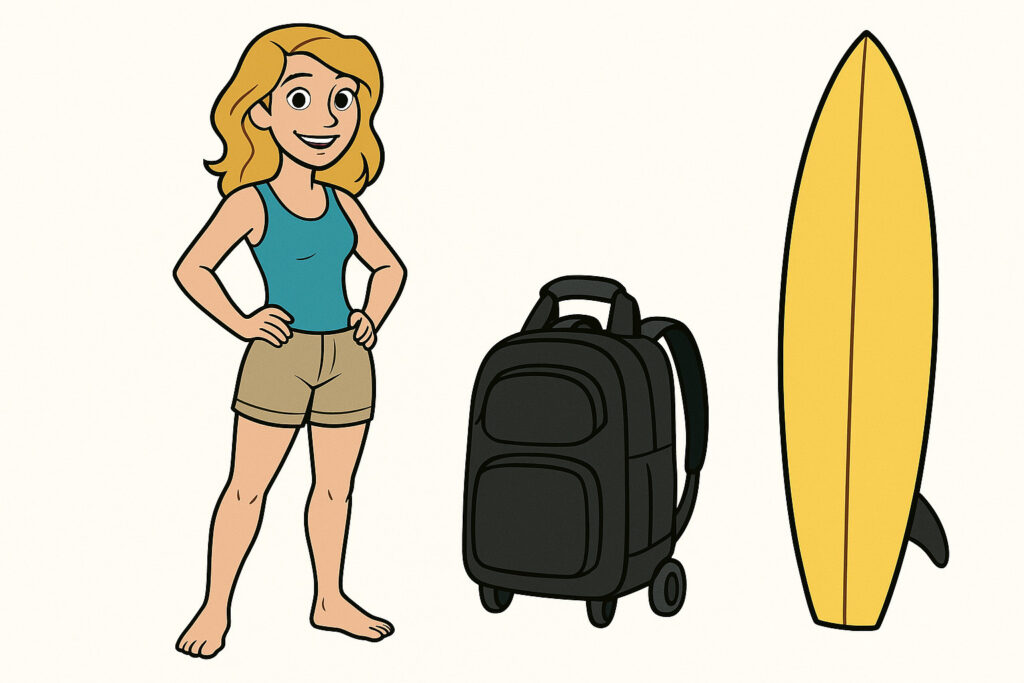

1. Referenzbilderstellung: Detaillierter Prompt zur Erstellung eines Charakters und passender Utensilien

„A product-style reference image in the style of Kim Possible, set against a white background. Featuring three key visual elements, drawn separately and clearly: 1) A 25-year-old surfer girl, medium-length wavy blonde hair, large expressive eyes, cheerful expression. Wearing a turquoise tank top and beige shorts, sporty physique, relaxed pose, front view. 2) A compact, modern hybrid backpack and carry-on suitcase, black, with wheels and carrying handles, stylized and cartoonish. 3) A short yellow surfboard, about 6 feet long, clean modern shape, vivid yellow color, stylized like a Kim Possible prop. Clean outlines, bold colors, flat cell shading, minimalistic and clear layout. 2D character sheet design, cartoon reference style, Kim Possible style, separated components„

Szene 1: "Das Chaos vor der Reise"

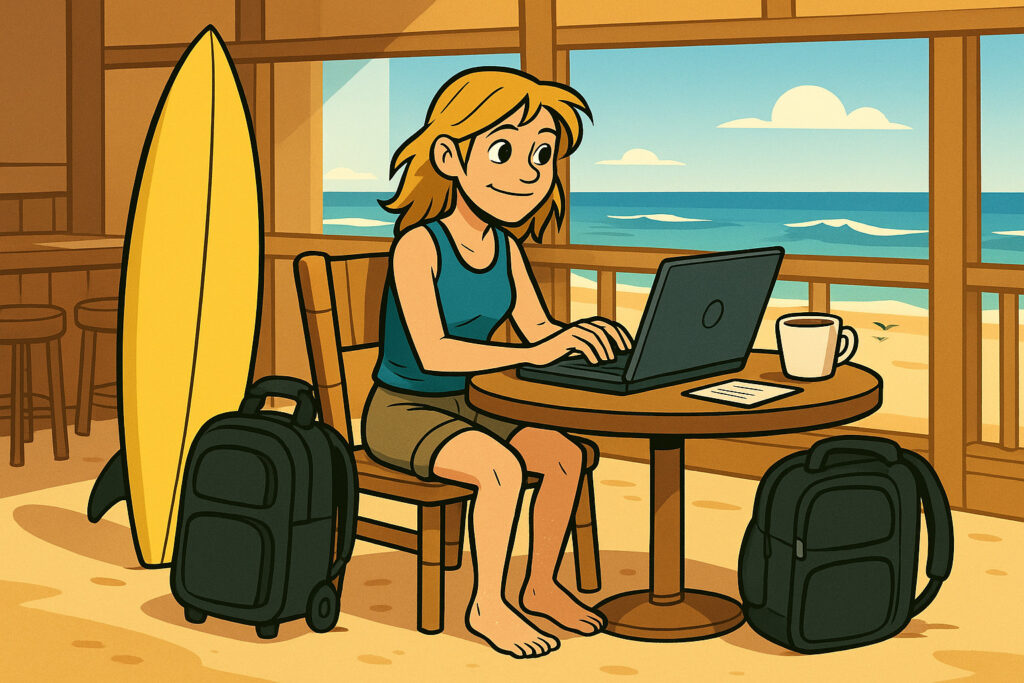

Szene 2: „Auf dem Weg zum Atlantik“

Szene 3: „Endlich am Spot!“

Szene 4: „Back to Business“

Character Reference Systeme (Midjourney v7)

Wie es funktioniert: Du erstellst oder lädst ein Portrait hoch – frontal, neutrale Beleuchtung, einfacher Hintergrund. Dann nutzt du die Omni-Reference und lädst dort dein Portrait hoch. Über Omni Strength (--ow) steuerst du, wie stark die Übertragung sein soll.

Die Magic Numbers (Wertebereich: 1 bis 1000, Standard ist 100):

- –ow 400+: Hohe Detailtreue und Ähnlichkeit zum Referenzbild – ideal für Business-Portraits und spezifische Gesichtsmerkmale

- –ow 50-200: Ausgewogene Mischung, der Sweet Spot für die meisten Anwendungen

- –ow 1-25: Nur Grundzüge bleiben erhalten, perfekt für starke Stiltransformationen (z.B. Foto zu Anime)

Perfekt für: Einzelportraits, kontrollierte Variationen, Business-Content Grenzen: Funktioniert am besten mit klaren Portrait-Referenzen, bei komplexen Posen oder extremen Blickwinkeln wird’s herausfordernd

„a hyper-realistic business portrait photo of a woman in her early 30s, subtle confident smile, natural skin texture with visible pores and fine lines, realistic lighting with soft shadows, wearing a tailored navy blazer and white blouse, standing in a real office setting with glass walls and blurred background elements, medium close-up shot, shot straight on, captured with a Canon EOS R5 and 85mm lens, f1.8 aperture, shallow depth of field, sharp facial features, neutral tones, no retouching, lifelike expression, DSLR photo, professional corporate style, realistic skin tones, high-resolution, daylight photography, zero beauty filter, documentary style, cinematic natural light –ar 3:4 –raw –ow 25/ 200/ 500“

Corporate Portrait --ow 25

Corporate Portrait --ow 200

Corporate Portrait --ow 500

FLUX.1 Kontext: Der iterative Ansatz

Wie es funktioniert: Statt bei Null zu starten, nutzt FLUX.1 Kontext bestehende Bilder als Ausgangspunkt. Du kannst ein Bild hochladen und mit Text-Anweisungen schrittweise verändern: „Ändere den Hintergrund zu einem Büro“ oder „Lass die Person lächeln“. Dabei bleiben Charakterzüge und Stil erhalten.

Die Stärke liegt in der Geschwindigkeit – bis zu 8x schneller als andere Modelle – und der Möglichkeit, iterativ zu arbeiten ohne Qualitätsverluste.

Praxis-Anwendung: Ideal für Produktbilder, die du in verschiedene Kontexte setzen willst, oder wenn du einen Avatar schrittweise entwickeln möchtest.

Perfekt für: Iteratives Arbeiten, schnelle Anpassungen, Produktbilder, Stilübertragungen Grenzen: Noch relativ neu, bei exzessiven Bearbeitungsschritten können visuelle Artefakte entstehen

Hier ein kleines Beispiel:

In unserem Garten hängt ein Wildbienenhotel, in dem die Bienen ihre Eier ablegen können. Ich habe ein Foto davon gemacht und es als Referenzbild im Flux-Kontext verwendet. Anschließend habe ich mit verschiedenen Prompts unterschiedliche Szenarien durchgespielt. So lässt sich das Thema direkt viel anschaulicher und kreativer präsentieren. Für Produktshootings ist das wirklich Gold wert!

Wie ihr sehen könnt, hat es mir richtig viel Spaß gemacht, mal über den Tellerrand zu schauen – und dank KI auch ein paar imaginäre Szenen zu erstellen. Kreativ zu werden ist mit KI wirklich super einfach und macht richtig Laune!

LoRA-Training: Der Profi-Weg

Mit Hilfe eines LoRA kann man einem Ki-Modell ein zusätzliches Konzept beibringen. Sei es ein Mensch, ein Produkt oder ein Bildstil. So kann man z.B. Flux.1 [dev] beibringen wie man selbst aussieht.

Wie es funktioniert: Du sammelst 15-30 Trainingsbilder deines Charakters (50% Nahaufnahmen, 30% Medium Shots, 20% Ganzkörper) und trainierst ein Mini-KI-Modell. Die optimale Verteilung: mindestens 3 verschiedene Outfits, 2 unterschiedliche Hintergründe, verschiedene Posen und Perspektiven; denn Varianz im Datenset ist wichtig für ein flexibles Model.

Für das LoRA-Training gibt es verschiedene Ansätze von simpel (Charakter auf freepik.com) über komplizierter (Ostris AI Toolkit auf replicate.com) bis hin zu komplett lokal (kohya_ss oder Ostris AI Toolkit auf eigener Hardware)

Nach dem Training (dauert zwischen 30-720 Minuten – je nach Intensität) hast du einen personalisierten „Trigger“ – ein spezielles Wort, das deinen Charakter in jedem Prompt aktiviert.

Perfekt für: Höchste Konsistenz, professionelle Kampagnen, reale Personen, lange Bildserien

Grenzen: Höherer initialer Aufwand, technisches Know-how nötig, Datenschutz bei realen Personen kritisch wenn über Cloud-Dienste gelöst.

Ein Gesicht, viele Szenarien: Was mit einem LoRA möglich ist

Wir haben ein individuelles LoRA-Modell (Low-Rank Adaptation) für diese Frau erstellt – auf Basis von etwa 15 bis 30 Fotos. Das bedeutet: Die KI hat gelernt, ihr Aussehen, ihre Gesichtszüge und ihren Stil zu erkennen und in neue Bildwelten zu übertragen.

Mit diesem maßgeschneiderten Modell können wir nun verschiedenste Szenarien generieren – ob als Business-Porträt, im Outdoor-Setting oder im fantasievollen Editorial-Look. Der große Vorteil: Wir behalten dabei immer den Wiedererkennungswert und müssen kein komplettes Shooting für jede neue Bildidee planen. Schnell, flexibel und visuell konsistent.

Die Beispielbilder fürs LoRA-Training habe ich mit Flaic.de gebaut – eine ziemlich praktische Plattform für Bildgenerierung & Modelltraining ohne viel Technik-Gefrickel. Gerade wenn's um Konsistenz geht, spart das richtig Zeit und Nerven. Und ja: dahinter steckt übrigens unser Georg. 😉

Hier noch eine kleine imaginäre Reihe der TOK-Woman in Miniaturansicht – natürlich mit ihrem treuen Wegbegleiter an der Seite.

Zwei Sofort-Tipps für bessere Konsistenz

Tipp 1: Das perfekte Referenzbild erstellen

Dein Erfolg steht und fällt mit der Qualität deines Ausgangsmaterials. Die Faustregeln:

- Frontale Ausrichtung: Das Gesicht sollte direkt zur Kamera blicken

- Neutrale Beleuchtung: Keine harten Schatten oder dramatische Lichtstimmungen

- Einfacher Hintergrund: Weniger Ablenkung = bessere Fokussierung auf den Charakter

- Zeitlose Kleidung: Vermeide zu spezifische Outfits, die du später nicht mehr willst

Tipp 2: Die Referenz-Strategie

Bei dialogbasierten Ansätzen ist das „Gedächtnis auffrischen“ entscheidend. Alle 3-4 Bilder solltest du den ursprünglichen Charakter explizit erwähnen: „Nutze wieder den Charakter aus dem ersten Bild und…“ Das verhindert die schleichende Charakterdrift.

Realitätscheck: Wo es noch hakt

Seien wir ehrlich: Perfektion gibt es noch nicht. Die häufigsten Stolpersteine:

Bei realen Personen stößt die Ein-Bild-Referenz schnell an ihre Grenzen. Ein Foto hochladen und erwarten, dass die KI die Person exakt reproduziert? Das funktioniert selten zufriedenstellend. Hier ist LoRA-Training oft der einzige Weg zu professionellen Ergebnissen. Mit einem gut trainierten LoRA kommen die Resultate erstaunlich nah an das Original heran – auch wenn nicht jedes generierte Bild perfekt ist und eine Auswahl nötig bleibt.

Interaktionen zwischen Charakteren sind machbar, aber fehleranfälliger. Zwei Personen können sich durchaus die Hand geben oder miteinander sprechen – aber rechne mit mehr Generierungsversuchen als bei simplen Portraits. Die Konsistenz leidet, je komplexer die Szene wird.

Bei Referenz-Methoden ist das „Auffrischen“ entscheidend. Nutzt du nur ein Bild als Referenz, solltest du es alle 3-4 Generierungen erneut mit angeben. Sonst driftet der Charakter merklich ab – manchmal schon nach wenigen Bildern.

Die gute Nachricht: Die Entwicklung ist rasant. Was heute noch knifflig ist, könnte in 6-12 Monaten Standard sein.

Next Steps: Vom Wissen zur Anwendung

Du siehst das Potenzial, aber die praktische Umsetzung fühlt sich noch überwältigend an? Das geht vielen so. Die Tools entwickeln sich schneller, als man mithalten kann, und jedes hat seine Eigenarten.

Im KI Marketing Bootcamp gehen wir systematisch vor: Von der Strategie über die Tool-Auswahl bis zur konkreten Umsetzung. Du lernst nicht nur die Theorie, sondern arbeitest an echten Projekten – mit direktem Feedback und praktischen Workflows, die du sofort umsetzen kannst.

Denn eines ist klar: Charakterkonsistenz entwickelt sich gerade von einem „Nice-to-have“ zu einer Grunderwartung in professionellen Marketing-Workflows. Die Frage ist nicht ob, sondern wann du einsteigst.

KI entdecken. Ausprobieren. Lernen.

Ich bin selbst noch dabei, all die Möglichkeiten zu entdecken. Und genau das macht es spannend: Aus kleinen Experimenten werden oft konkrete Workflows, die später im Marketing-Alltag richtig Wirkung zeigen.

Wer tiefer einsteigen will, findet in unseren KI Bootcamps & Schulungen den passenden Rahmen – praxisnah, individuell und direkt umsetzbar.

Fazit

Charakterkonsistenz in der KI-Bildgenerierung ist kein Hexenwerk – aber auch kein Selbstläufer. Jede der vier Methoden hat ihre Berechtigung: ChatGPT für schnelle Konzepte, Midjourney v7 für kontrollierte Variationen, LoRA für höchste Präzision und FLUX.1 Kontext für iteratives Arbeiten.

Der Schlüssel liegt darin, die richtige Methode für dein Projekt zu wählen. Brauchst du schnell ein Maskottchen für Social Media? Dialogbasierte Ansätze reichen völlig. Planst du eine professionelle Kampagne mit einem realen Markenbotschafter? Dann führt kein Weg an LoRA-Training vorbei.

Wichtig dabei: Erwarte keine Perfektion auf Anhieb. Auch wir mussten mehrere Anläufe nehmen, bis unsere Surfer-Comic-Serie stimmig war. Das gehört dazu und wird mit der Zeit besser.

Die KI-Bildgenerierung entwickelt sich rasant weiter. Was heute noch aufwändig ist, könnte morgen Standard sein. Aber die Grundprinzipien – gute Referenzen, klare Prompts und Geduld beim Iterieren – die bleiben.

Bereit für den nächsten Schritt?

Die Tools entwickeln sich schnell, und jedes hat seine Besonderheiten.

Im KI Marketing Bootcamp gehen wir systematisch vor: Von der Strategie über die Tool-Auswahl bis zur konkreten Umsetzung. Du lernst nicht nur die Theorie, sondern arbeitest an echten Projekten – mit direktem Feedback und praktischen Workflows, die du sofort einsetzen kannst.

Was erwartet dich?

- Praxisorientierte Anleitungen: Lerne, wie du KI-Tools strategisch einsetzt und das Beste aus ihnen herausholst

- Erprobte Workflows: Vom Konzept bis zur Umsetzung – mit sofort anwendbaren Strategien

- Individuelle Begleitung: Kleine Gruppen und persönliche Betreuung bei deinen Projekten

Deine Vorteile:

- Learning by Doing: Entwickle eigene Kampagnen, die auf deine spezifischen Ziele zugeschnitten sind

- Praxiswissen: Nutze echte Beispiele und Erfolgsstrategien für deine eigenen Projekte

- 100% Online: Flexibel lernen, wann es in deinen Zeitplan passt

Für Unternehmen: Maßgeschneiderte Workshops für dein Marketing-Team.

Dein Expertenteam: Vroni Hackl und Georg Neumann – dein Expertenteam und deine Guides durch KI im Marketing.