Nach Prompt Engineering kam Context Engineering. Jetzt zeichnet sich ab, was als Nächstes kommt: Skills Engineering. Ich rechne damit, dass der Begriff in den kommenden Monaten zunehmend auftaucht. Denn die Entwicklung dahin, was damit gemeint ist, ist sinnvoll und konsequent, wenn man bessere Ergebnisse mit KI erzielen will.

Was ist Skills Engineering?

„Skills Engineering beschreibt die Kompetenz, menschliches Prozesswissen so aufzubereiten, dass KI-Agenten es nutzen können.“ (Vroni)

Das klingt abstrakt, meint aber etwas sehr Konkretes. KI-Agenten, also Systeme wie Claude Code, Gemini CLI oder GitHub Copilot, die eigenständig mehrstufige Aufgaben ausführen, bringen zwar breites Wissen mit. Aber sie wissen nicht, wie in eurem Unternehmen ein Angebot geschrieben wird, welche Tonalität eure Marke verlangt oder welche Fehler bei der Kampagnenplanung typischerweise passieren. Dieses prozedurale Wissen, also das Wie der Arbeit, können Menschen ihnen in strukturierter Form mitgeben. Diese strukturierten Wissenspakete heißen in der Technik „Agent Skills“.

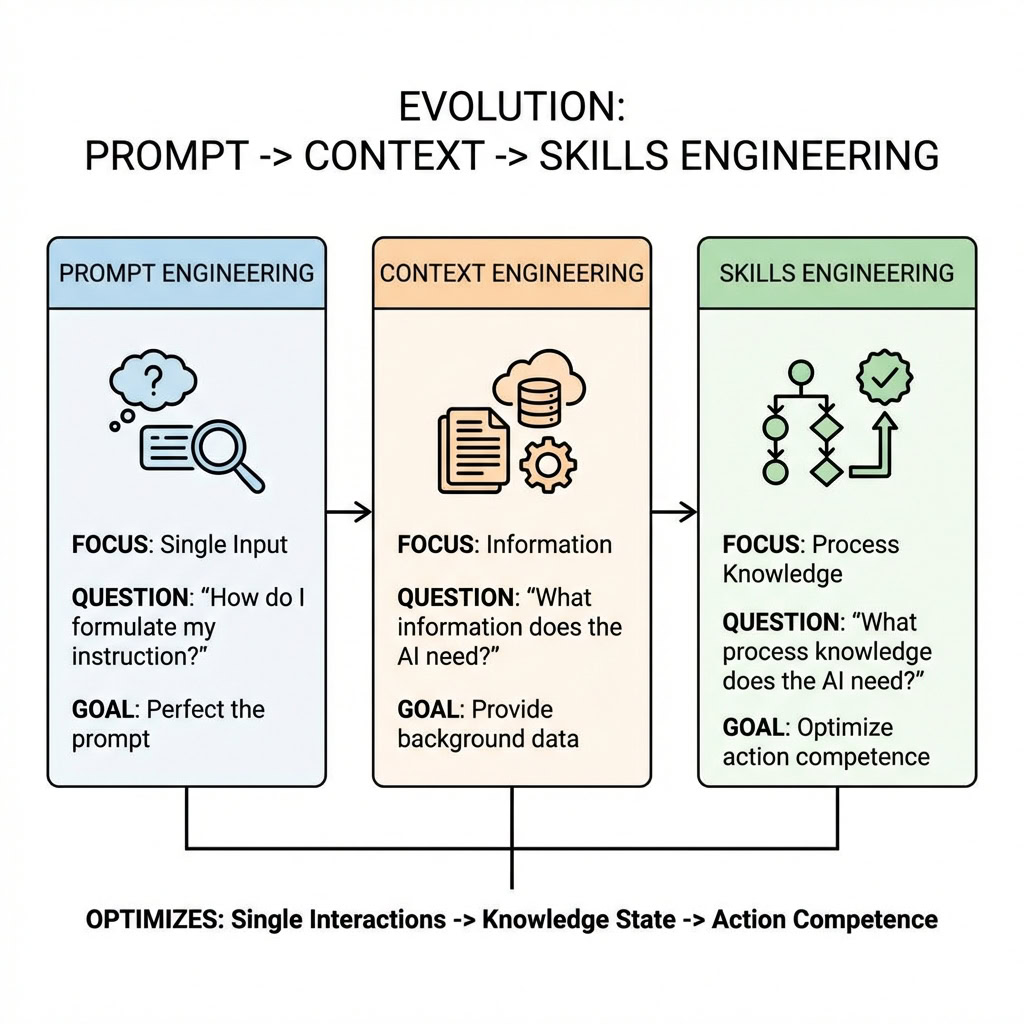

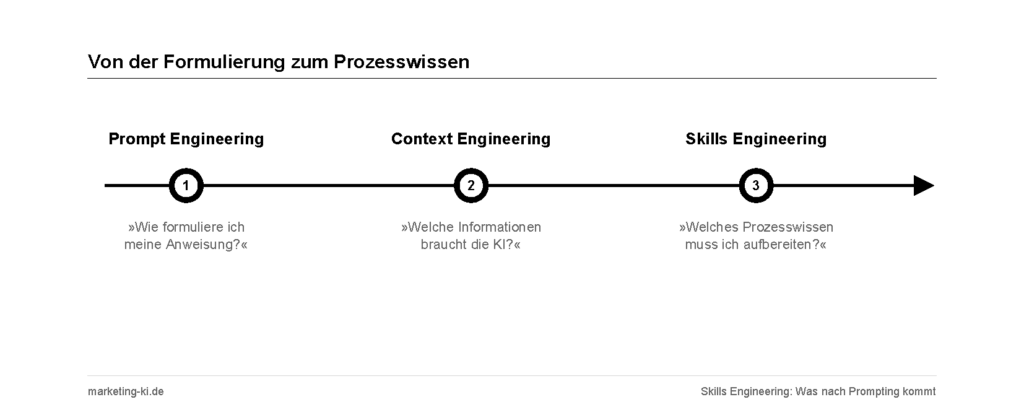

Die drei Stufen lassen sich so abgrenzen:

Prompt Engineering fragte: Wie formuliere ich meine Anweisung? Der Fokus lag auf dem einzelnen Input, dem perfekten Prompt.

Context Engineering fragte: Welche Informationen braucht die KI? Der Fokus verschob sich auf den Kontext: Dokumente, Daten, Hintergrundwissen, das dem Modell zur Verfügung gestellt wird.

Skills Engineering fragt: Welches Prozesswissen muss die KI haben, um meine Arbeit zu verstehen? Der Fokus liegt nicht auf Fakten, sondern auf Vorgehensweisen, Qualitätskriterien und Entscheidungslogiken. Nicht „was wir wissen“, sondern „wie wir arbeiten“.

Der Unterschied ist nicht nur semantisch. Prompt Engineering optimierte einzelne Interaktionen. Context Engineering optimierte den Wissensstand des Modells. Skills Engineering optimiert die Handlungskompetenz des Agenten, also seine Fähigkeit, eine Aufgabenklasse wiederholt und zuverlässig zu bearbeiten.

Kein Anthropic-Feature, ein offener Standard

Wer jetzt denkt, das sei ein Marketing-Trick eines einzelnen Anbieters, liegt falsch. Anthropic hat die Agent-Skills-Spezifikation ursprünglich entwickelt. Inzwischen ist sie ein offener Standard, der plattformübergreifend funktioniert. Ein Agent Skill besteht aus einem Ordner mit einer Markdown-Datei (SKILL.md), die beschreibt, wie eine bestimmte Art von Aufgabe gelöst wird. Optional kommen Ressourcen dazu: Vorlagen, Skripte oder Beispieldaten.

Das Format wird Stand März 2026 nativ unterstützt von GitHub Copilot, Gemini CLI, Cursor, Windsurf, OpenAI Codex und über 30 weiteren Coding-Agenten. GitHub Copilot liest sogar automatisch Skills aus, die für Claude Code angelegt wurden. Es gibt einen Marktplatz mit über 40.000 veröffentlichten Skills, CLI-Tools, die ein Skill gleichzeitig auf mehrere Agenten installieren, und Security-Registries, die Skills auf Sicherheitslücken scannen.

Das ist keine Nische. Das ist Infrastruktur.

Was die Forschung zeigt

SkillsBench, ein im Februar 2026 veröffentlichter Benchmark, liefert die erste systematische Messung dessen, was Skills bewirken. 84 Aufgaben aus 11 Fachgebieten und sieben Modell-Agenten-Kombinationen in über 7.300 Testläufen. Drei Bedingungen: ohne Skills, mit von Menschen geschriebenen Skills und mit selbst-generierten Skills. Bei der letzten Variante wurde die KI aufgefordert, sich ihr eigenes Prozesswissen zu schreiben, bevor sie die Aufgabe löst.

Vier Befunde, die für die Praxis relevant sind.

Menschliches Prozesswissen wirkt massiv. Von Menschen geschriebene Skills verbessern die Leistung im Durchschnitt um 16,2 Prozentpunkte. In Domänen mit hohem Spezialwissen ist der Effekt noch größer: plus 51,9 Prozentpunkte im Gesundheitsbereich, plus 41,9 in der Fertigung. In Bereichen, in denen Modelle bereits viel Vorwissen haben, etwa Softwareentwicklung, liegt der Effekt bei plus 4,5 Prozentpunkten. Die Übersetzung: Je spezialisierter eure Arbeit, desto mehr profitiert die KI von eurem strukturierten Wissen.

Die KI kann dieses Wissen nicht selbst erzeugen. Selbst-generierte Skills bringen im Durchschnitt minus 1,3 Prozentpunkte. Das ist nicht neutral, das ist schlechter als gar keine Skills. Die Studie identifiziert zwei Fehlermuster: Entweder produziert die KI vage Anleitungen („nutze ein geeignetes Framework“ statt konkreter Schritte), oder sie erkennt gar nicht, dass spezialisiertes Wissen fehlt, und versucht es mit Allgemeinwissen. Das bestätigt eine Beobachtung aus unseren Seminaren: KI simuliert Kompetenz. Sie profitiert enorm von menschlicher Expertise, kann sie aber nicht ersetzen.

Weniger ist mehr. Aufgaben mit zwei bis drei fokussierten Skills zeigten die besten Ergebnisse (plus 18,6 Prozentpunkte). Bei vier oder mehr Skills sackte der Effekt auf plus 5,9 Prozentpunkte. Umfassende Dokumentation, also der Impuls, dem Agenten möglichst alles zu geben, schadet sogar: minus 2,9 Prozentpunkte. Die Agenten werden offenbar überflutet und extrahieren nicht mehr die relevanten Informationen. Präzision schlägt Vollständigkeit.

Das richtige Wissen schlägt das teurere Modell. Claude Haiku, das kleinste getestete Claude-Modell, erreichte mit Skills 27,7 Prozent Erfolgsquote. Das deutlich leistungsfähigere Claude Opus ohne Skills kam auf 22,0 Prozent. Für Budget-Entscheidungen in Unternehmen hat das konkrete Konsequenzen: Bevor ihr das teuerste Modell lizenziert, investiert in die Dokumentation eures Prozesswissens.

Was Skills Engineering mit eurem Alltag zu tun hat

Die meisten Marketing-Teams arbeiten heute nicht mit Coding-Agenten, die SKILL.md-Dateien auslesen. Noch sind wir in der Welt der Chatbot-Fenster und Copy-Paste-Workflows. Aber die Entwicklung, die ich im Artikel über Modell, App und Unterbau beschrieben habe, zeigt die Richtung: KI-Systeme werden autonomer. Und die Prinzipien von Skills Engineering gelten schon jetzt.

Denn was Skills Engineering im Kern beschreibt, ist nichts anderes als das, was gute Briefings schon immer ausgemacht hat: nicht nur sagen, was herauskommen soll, sondern dokumentieren, wie man dorthin kommt. Schritte in welcher Reihenfolge, typische Fehler, geltende Qualitätskriterien und Branchenkonventionen.

Wir sehen den Skills-Effekt im Kleinen, wenn Seminarteilnehmer anfangen, ihre Prompts nicht mit mehr Wörtern, sondern mit dem richtigen Wissen anzureichern. Die Marketingleiterin, die ihrem KI-Assistenten nicht nur „Schreib einen Newsletter“ sagt, sondern die Tonalitätsregeln, die Zielgruppenkenntnis und die Dos-and-Don’ts der Marke mitgibt, macht intuitiv Skills Engineering. Nur nennt sie es nicht so.

Im Produktivitätsartikel habe ich beschrieben, dass Strategie, Kuration und Kontextwissen die eigentlichen Upskilling-Kandidaten in der KI-Ära sind. Skills Engineering macht das greifbar: Die Fähigkeit, das eigene Fachwissen so zu strukturieren, dass es teilbar und wiederverwendbar wird, ist genau die Kompetenz, die nicht automatisierbar ist.

Drei Einwände, die ich für berechtigt halte

Erstens: Die SkillsBench-Studie testet Coding-Agenten in containerisierten Umgebungen. Das ist weit entfernt vom Alltag eines Kommunikationsteams. Ob sich die Effektstärken auf Textarbeit, Kampagnenplanung oder Bildgenerierung übertragen, ist nicht belegt. Die Prinzipien, präzise Anleitung schlägt vages Allgemeinwissen, sind plausibel. Aber Vorsicht vor Eins-zu-eins-Übertragungen.

Zweitens: Skills Engineering klingt nach einer neuen Kompetenz, die man lernen muss. In Wahrheit beschreibt es etwas, das erfahrene Fachleute bereits können: ihr Wissen strukturiert weitergeben. Die Gefahr ist, dass der Begriff zu einem weiteren Zertifikatskurs wird, der Form über Substanz stellt. Die eigentliche Kompetenz ist und bleibt das Fachwissen selbst.

Drittens: Der Begriff verschleiert, dass die Voraussetzung für gute Skills das ist, was in der Forschung als Metakognition bezeichnet wird, die Fähigkeit, den eigenen Arbeitsprozess bewusst zu reflektieren. Wer nicht erklären kann, wie er eine Aufgabe löst, kann das auch keinem Agenten beibringen. Skills Engineering ist nur so gut wie die Selbstreflexion der Menschen, die die Skills schreiben.

Was bleibt

Skills Engineering ist kein Paradigmenwechsel. Es ist die logische Konsequenz einer Entwicklung, die wir seit dem Übergang von Chatbots zu Agenten beobachten: Je eigenständiger KI-Systeme arbeiten, desto wichtiger wird das strukturierte Prozesswissen, das Menschen ihnen mitgeben. Die Daten aus SkillsBench machen das erstmals quantifizierbar. Und sie belegen nebenbei, dass die KI dieses Wissen nicht selbst generieren kann.

Dass Agent Skills innerhalb weniger Monate zu einem plattformübergreifenden Standard geworden sind, den alle großen Anbieter unterstützen, zeigt: Das ist keine Mode, sondern eine Infrastrukturentwicklung. Die Frage ist nicht, ob Skills Engineering relevant wird. Die Frage ist, wer in eurem Team das Prozesswissen hat, das die Agenten brauchen, und ob dieses Wissen irgendwo dokumentiert ist.

Die Antwort auf diese Frage entscheidet darüber, ob KI in eurer Organisation ein Produktivitätswerkzeug wird oder ein Zufallsgenerator für plausibel klingenden Output.

Praxis-Take-Away: Euer erstes „Skill-Dokument“

Ihr müsst nicht auf KI-Agenten warten, um von der Idee zu profitieren. Nehmt eine wiederkehrende Aufgabe aus eurem Team und dokumentiert sie so, dass ein neuer Mitarbeiter, oder eben eine KI, sie erledigen könnte.

In 20 Minuten:

Wählt eine Aufgabe, die ihr regelmäßig macht und die jedes Mal ähnlich abläuft. Zum Beispiel: einen Social-Media-Post aus einem Blogartikel erstellen, ein Angebot für einen bestimmten Seminartyp schreiben, eine Wettbewerbsanalyse aktualisieren.

Schreibt auf einer Seite auf: Was ist das Ziel? Was sind die Schritte, konkret, in Reihenfolge? Welche Fehler passieren typischerweise? Was unterscheidet ein gutes Ergebnis von einem mittelmäßigen?

Eine Copy-Paste-Vorlage für Skills

---

name: mein-skill-name

description: >

Beschreibt in 1–2 Sätzen, was der Skill tut UND wann er

aktiviert werden soll. Der Agent liest nur diesen Text,

um zu entscheiden, ob der Skill zur Aufgabe passt.

---

# [Titel: Was dieser Skill tut]

## Ziel

[Was soll am Ende rauskommen? Konkret und messbar.

Nicht "guter Content", sondern z.B.: Ein LinkedIn-Post,

max. 1.300 Zeichen, mit These und Frage am Ende.]

## Schritte

1. [Erster Schritt: Was genau tun?]

2. [Zweiter Schritt]

3. [Dritter Schritt]

4. [...]

## Häufige Fehler vermeiden

- NICHT [typischer Fehler, der immer wieder passiert]

- NICHT [zweiter Fehler]

- KEINE [was ihr nicht im Ergebnis sehen wollt]

## Qualitätskriterien

- [Woran erkennt euer Team, dass das Ergebnis gut ist?]

- [Was unterscheidet gut von mittelmäßig?]

Hier gibts noch mehr Vorlagen--> Was ihr davon habt, jetzt schon:

Erstens Klarheit. Die meisten Menschen können ihre Routineaufgaben nicht in Schritte zerlegen, weil sie sie auf Autopilot erledigen. Das Aufschreiben zwingt zur Reflexion und offenbart oft, wo implizites Wissen steckt, das nirgends dokumentiert ist.

Zweitens Skalierbarkeit. Dieses Dokument ist sofort nützlich, als Einarbeitung für neue Teammitglieder, als Briefing für Freelancer, als Grundlage für eine Prozessverbesserung. Und wenn KI-Agenten in euren Workflow einziehen, habt ihr die Vorarbeit bereits geleistet.

Drittens den Beweis, dass die eigentliche Kompetenz nicht im Tool liegt. Sie liegt im Kopf der Person, die weiß, wie die Arbeit funktioniert.

Quellen

SkillsBench Paper:

Li, X., Chen, W., Liu, Y., et al. (2026). SkillsBench: Benchmarking How Well Agent Skills Work Across Diverse Tasks. arXiv preprint arXiv:2602.12670v1.

Anthropic Agent Skills:

Anthropic (2025). Equipping Agents for the Real World with Agent Skills. Anthropic Engineering Blog.

GitHub Copilot Agent Skills:

GitHub Changelog (2025). GitHub Copilot now supports Agent Skills. Dezember 2025.

Gemini CLI Agent Skills:

Google (2026). Agent Skills – Gemini CLI Documentation.

Agent Skills Open Standard:

agentskills.io – The Agent Skills Specification.