Woher weiß ich, was ein Mensch geschrieben hat – und was eine KI? Menschen können dies nicht unterscheiden. Auch wenn sie es behaupten… Wie sieht es mit einer anderen KI aus? Erkennt sie, was künstlich generierter Text ist? Ein paar Tools gab’s ja schon, die das mittelgut unterscheiden konnten. Jetzt hat OpenAI einen classifier rausgebracht. Wir widmen uns also einem heißen Thema. KI Texte erkennen: Funktionieren die Detection Tools?

Das neueste Tools vom Platzhirsch itself: OpenAI classifier

Hier die Eckdaten, wie zuverlässig das neue Tool von OpenAI KI-produzierte Texte erkennt: Aus dem Test-Set an englischsprachigen Texten wurden 26% der Texte korrekt als KI-produziert erkannt, aber auch 9% der vom Menschen geschriebenen als KI-produziert gelabelt. Schon ärgerlich… oder ein Gütesiegel, wenn man so schreibt, dass die KI einen für seinesgleichen hält?

Die Zuverlässigkeit der Bewertung: Tendenziell Münzwurf

Die Zuverlässigkeit der Ergebnisse ist bei längeren Texten besser als bei kürzeren. Insgesamt ist das Ergebnis auf gut deutsch also eher mau. Auch eine KI kann definitiv nicht zuverlässig erkennen, ob ein Text von einer KI erzeugt wurde oder nicht. OpenAI selbst gibt folgende Hinweise: Das Tool funktioniert wirklich sehr schlecht bei Texten, die kürzer sind als 1.000 Zeichen. Und sogar noch schlechter, wenn die Texte nicht englischsprachig sind. Vom Menschen editierte Texte sind nicht identifizierbar.

Aber: Einfach ausprobieren. Hier geht’s zum Tool.

Wie funktionieren KI Detection Tools überhaupt?

Die Detektoren überprüfen die Wahrscheinlichkeiten innerhalb eines Texts. Kurzer Exkurs: Die Text-KI kennt ja keine Zusammenhänge. Sie arbeitet lediglich mit Wahrscheinlichkeiten. Es wird prognostiziert, welcher Buchstabe am wahrscheinlichsten auf den vorhergehenden folgt. Diese Wahrscheinlichkeit lässt sich beziffern. Wenn die Buchstaben mit einer hohen Wahrscheinlichkeit aufeinanderfolgen, dann ist der Text vermutlich KI-produziert, so die Annahme des Detektors. Ganz simpel gesagt: Steht da wirres Zeug, dann nimmt das detection tool an, dass vermutlich ein Mensch dahintersteckt. Eine KI würde so etwas nicht tun 🙂

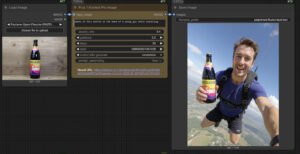

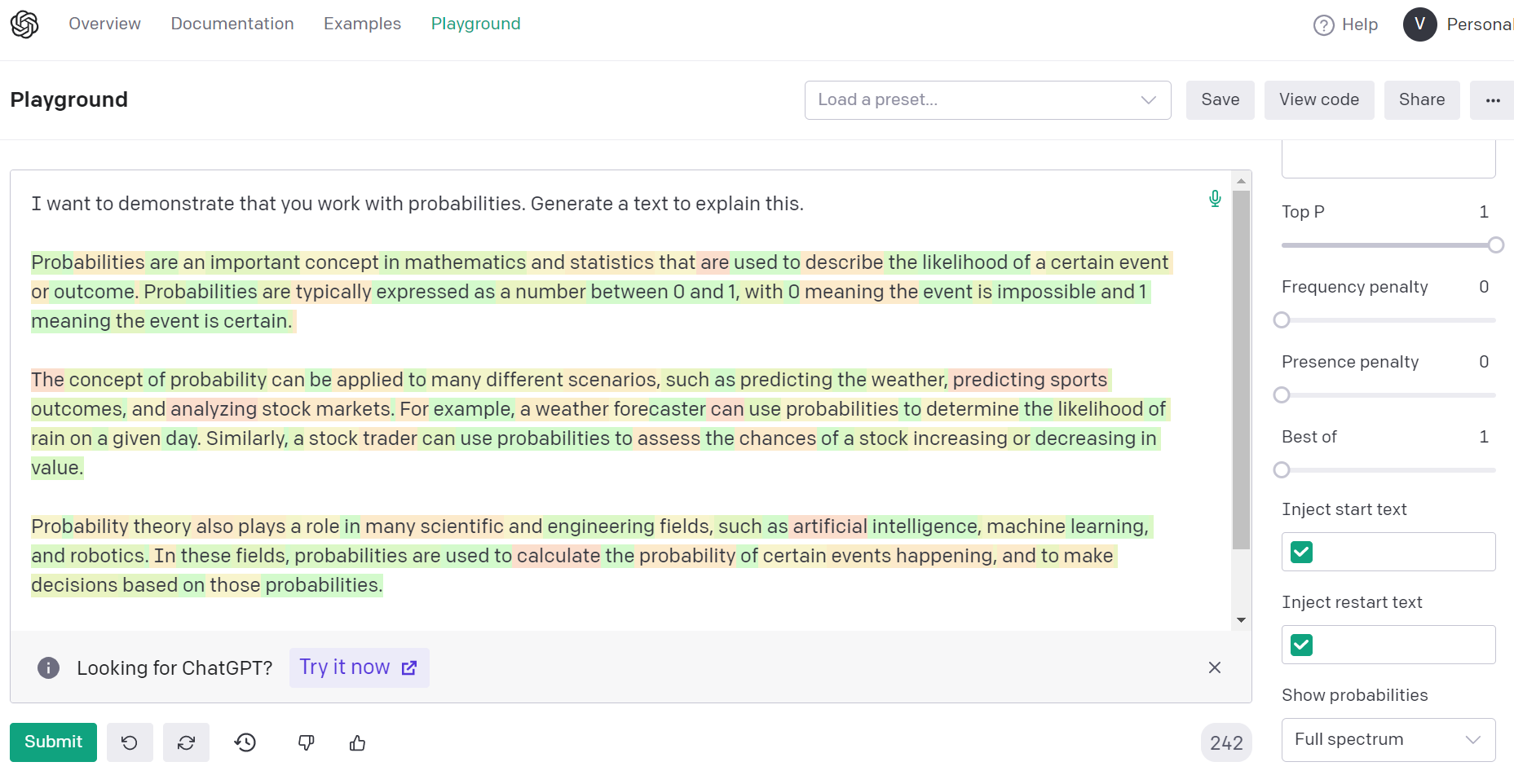

Übrigens könnt ihr euch im OpenAI Playground die Wahrscheinlichkeiten anzeigen lassen. Einfach bevor ihr auf „Submit“ klickt unten rechts „show probabilities“ aktivieren – siehe Screenshot:

KI-Texte erkennen: Welche Tools gibt’s noch?

Humans deserve the truth, sagt gptzero. Den Human Content Score berechnet Contentatscale. Und Ensur.it verspricht mehr Integrity in an AI-inhabited world. Und hier geht’s noch zu DetectGPT, das in Tests besser abschneidet, aber höhere Rechenleistung benötigt.

Und was ist mit Digital Watermarks?

Aktuell sind watermarks derzeit noch nicht im Einsatz, so OpenAI. Aber wie würden die überhaupt funktionieren? Noch ein Exkurs in die Statistik: Menschliche und natürliche Texte folgen einem Muster. Diese Muster lassen sich statistisch darstellen. Die zugrundeliegenden Wahrscheinlichkeiten dieser Muster bedingen die Texterzeugung. Auf das erste Wort folgt ein möglichst wahrscheinliches zweites Wort – und so fort. Eine Möglichkeit, einen Text zu „watermarken“ ist, die Satzstruktur zu verändern. Zu randomisieren. Aber eigentlich nur zu pseudo-randomisieren. Denn ein trainiertes System kann diese Pseudo-Randomisierung erkennen und daraus schließen, dass der Text künstlich generiert ist. Ein Mensch hat nicht die geringste Ahnung, dass irgendwas am Text pseudo-randomisiert – oder eben faul ist. Hier gibt’s mehr Informationen für die, die es genauer wissen wollen.

Fazit: Ein Wett-Rüsten um das Erkennen natürlicher Sprache

Insgesamt betrachtet wirkt es wie ein Wettrennen. Immer bessere Sprachmodelle produzieren immer bessere Texte und die Detektoren entwickeln sich weiter. Aber immer einen Schritt hintendran. Digital watermarks sind derzeit Zukunftsmusik und können nach Aussage von OpenAI auch leicht umgangen werden: Wenn man den Text umschreibt. KI Texte erkennen: Funktionieren die Detection Tools? Nicht wirklich gut.

und hier noch der Prompt zum Beitragsbild: stable diffusion 2.1: detective, close up portrait photo by annie leibovitz, film, studio lighting, detailed skin